不相关与独立是概率论中描述随机变量关系的两个核心概念,前者衡量线性关系,后者描述完全独立性,理解其区别对现代统计学和机器学习至关重要。

1. 数学定义与基本概念

不相关(Uncorrelated)的定义

两个随机变量 X 和 Y 被称为不相关,当且仅当它们的协方差为零:

$$\text{Cov}(X,Y) = E[XY] – E[X]E[Y] = 0$$

等价地,它们的相关系数为:

$$\rho_{X,Y} = \frac{\text{Cov}(X,Y)}{\sigma_X\sigma_Y} = 0$$

独立(Independent)的定义

两个随机变量 X 和 Y 被称为独立,当且仅当它们的联合分布等于边缘分布的乘积:

$$F_{X,Y}(x,y) = F_X(x) \cdot F_Y(y)$$

对于连续随机变量,这等价于:

$$f_{X,Y}(x,y) = f_X(x) \cdot f_Y(y)$$

对于离散随机变量,这等价于:

$$P(X=x,Y=y) = P(X=x) \cdot P(Y=y)$$

2. 直观理解与几何解释

不相关的直观理解

不相关意味着两个随机变量之间不存在线性关系。在二维散点图中,如果数据点的分布大致呈圆形或椭圆形,而没有明显的线性趋势,则这两个变量就是不相关的。

关键点:不相关只排除了线性关系,但可能存在非线性关系。

独立的直观理解

独立意味着一个随机变量的取值完全不会影响另一个随机变量的取值。无论 X 取什么值,Y 的条件分布都等于其边缘分布:

$$f_{Y|X}(y|x) = f_Y(y)$$

关键点:独立是比不相关更强的一个条件。

3. 两者之间的关系与重要定理

关系链

独立 ⇒ 不相关,但不相关 ⇏ 独立

这是一个单向蕴含关系:如果两个变量是独立的,那么它们一定是不相关的;但如果两个变量是不相关的,它们不一定独立。

重要定理

定理1:如果 X 和 Y 是独立的,那么它们一定是不相关的。

证明:

如果 X 和 Y 独立,则 E[XY] = E[X]E[Y],因此:

$$\text{Cov}(X,Y) = E[XY] – E[X]E[Y] = 0$$

定理2:对于联合正态分布的随机变量,不相关等价于独立。

这是唯一的重要例外:在正态分布情况下,这两个概念是等价的。

4. 反例与常见误解

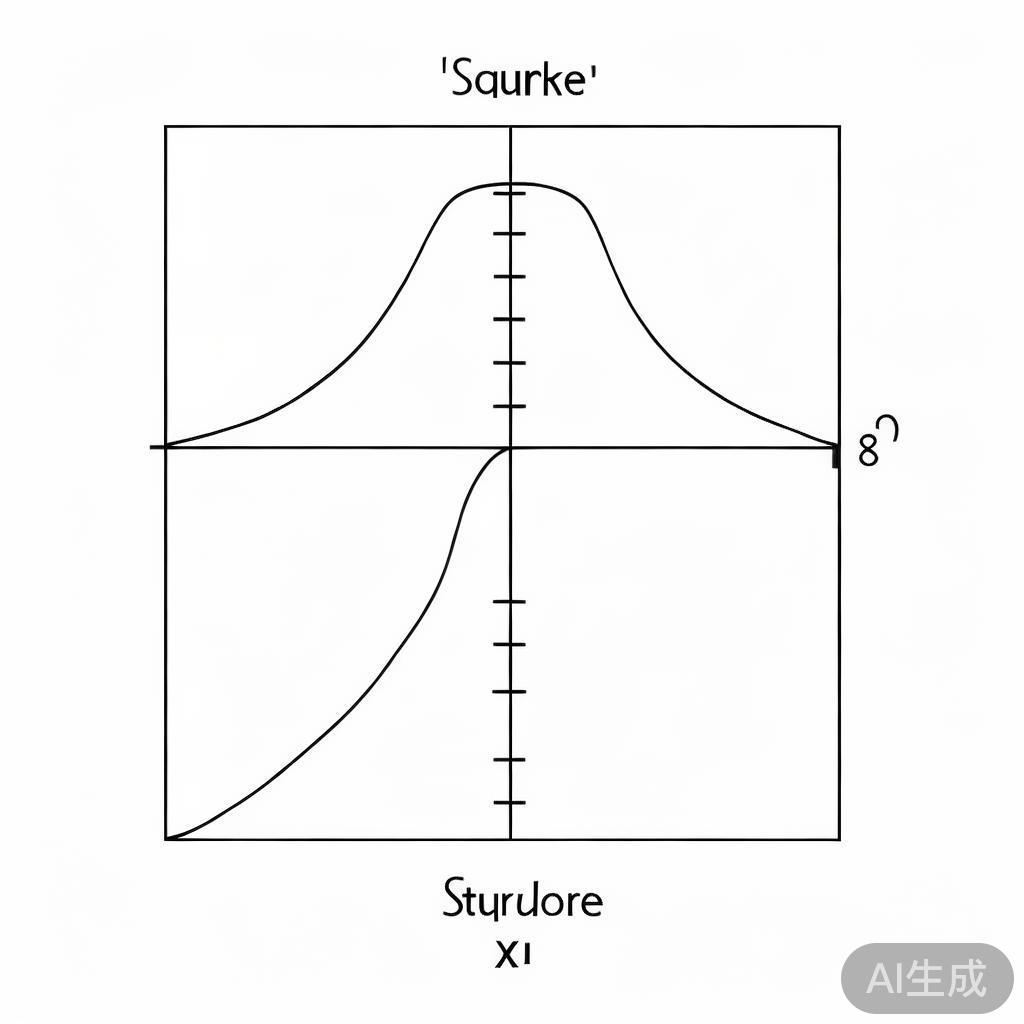

反例1:非线性关系

设 X ~ N(0,1),Y = X²

计算协方差:

$$\text{Cov}(X,Y) = E[X^3] – E[X]E[X^2] = 0 – 0 \cdot 1 = 0$$

因此 X 和 Y 不相关,但显然 Y 完全依赖于 X,所以它们不是独立的。

反例2:圆形分布

设 (X,Y) 在单位圆上均匀分布,即 X = cosθ,Y = sinθ,其中 θ ~ Uniform(0,2π)

计算协方差:

$$E[X] = E[\cos\theta] = 0$$

$$E[Y] = E[\sin\theta] = 0$$

$$E[XY] = E[\cos\theta\sin\theta] = \frac{1}{2}E[\sin2\theta] = 0$$

因此 Cov(X,Y) = 0,X 和 Y 不相关。但由于 Y² = 1 – X²,Y 完全依赖于 X,所以它们不是独立的。

常见误解

-

误解:不相关意味着没有关系

真相:不相关只意味着没有线性关系,可能存在复杂的非线性关系 -

误解:在所有情况下不相关都等价于独立

真相:仅在正态分布等特定情况下才等价 -

误解:样本相关系数为零意味着独立

真相:样本相关系数为零只表明样本中没有线性关系,不能推断独立性

5. 实际应用与重要性

统计学中的应用

- 回归分析:在多元回归中,如果预测变量之间不相关,则系数估计更稳定

- 时间序列分析:平稳序列的自相关函数为零时,序列不相关

- 实验设计:通过随机化确保处理组和对照组独立

机器学习中的应用

- 特征选择:选择不相关的特征可以减少冗余信息

- 降维技术:PCA 寻找不相关的主成分

- 集成学习:bagging 方法利用独立样本的多样性

金融风险管理

- 投资组合理论:寻找不相关的资产来分散风险

- 风险建模:理解不同风险因子之间的关系

6. 深入数学分析

矩母函数与独立性

如果 X 和 Y 独立,则它们的联合矩母函数等于边缘矩母函数的乘积:

$$M_{X,Y}(t_1,t_2) = M_X(t_1) \cdot M_Y(t_2)$$

这个性质可以用来证明独立性。

条件期望与独立性

X 和 Y 独立的另一个等价条件是:

$$E[g(X)h(Y)] = E[g(X)]E[h(Y)]$$

对于所有有界函数 g 和 h。

大数定律与中心极限定理

这些重要定理通常要求随机变量独立或不相关,以确保统计收敛性。

7. 高级概念与推广

多元情况下的推广

对于 n 个随机变量 X₁, X₂, …, Xₙ:

- 两两不相关:Cov(Xᵢ,Xⱼ) = 0,对于所有 i ≠ j

- 相互独立:联合分布等于所有边缘分布的乘积

时间序列中的概念

在时间序列分析中:

- 白噪声:序列不相关且均值为零

- 鞅序列:E[Xₜ|Xₛ] = Xₛ,对于 s < t

概率距离度量

两个独立随机变量的联合分布与边缘分布乘积之间的距离可以用来衡量独立性程度。

8. 实际计算与验证

实际步骤

要验证两个随机变量是否独立或不相关:

- 计算协方差:如果 Cov(X,Y) = 0,则不相关

- 检查独立性:验证联合分布是否等于边缘分布的乘积

- 使用统计检验:如卡方检验、Kolmogorov-Smirnov检验等

计算示例

例1:掷两个独立的骰子

– 设 X = 第一个骰子的点数

– 设 Y = 第二个骰子的点数

– X 和 Y 独立,因此不相关

例2:X ~ N(0,1),Y = X + Z,其中 Z ~ N(0,1) 且与 X 独立

– Cov(X,Y) = Cov(X,X+Z) = Var(X) + Cov(X,Z) = 1 + 0 = 1

– X 和 Y 相关,因此不独立

9. 常见陷阱与注意事项

样本 vs 总体

- 样本相关系数为零 ≠ 总体相关系数为零

- 样本独立 ≠ 总体独立

条件独立性

在给定某些条件下,变量可能条件独立但边缘不独立。

因果关系

不相关或独立不意味着没有因果关系,只是没有统计关系。

10. 总结与展望

不相关和独立是概率论中两个基础但重要的概念,它们在现代统计学、机器学习和数据科学中有着广泛的应用。理解它们的区别和联系对于:

- 正确解释统计结果

- 设计有效的实验

- 构建准确的模型

- 避免常见统计谬误

随着大数据和人工智能的发展,对这些基础概念的深入理解变得更加重要。未来的研究可能会探索在高维空间中推广这些概念,以及处理复杂依赖关系的数学工具。

概率论中的不相关与独立,看似简单的概念,实则蕴含着深刻的数学内涵和广泛的应用价值,值得我们深入学习和理解。

关键词:概率论,不相关,独立,随机变量,协方差,相关系数,统计学,机器学习,数学定义,实际应用